นับตั้งแต่การมาถึงของเทคโนโลยีปัญญาประดิษฐ์ (AI) ในช่วงปี 1950s เทคโนโลยี AI ก็ได้ก้าวหน้าอย่างรวดเร็ว จนมาถึงปัจจุบันที่ AI ได้พัฒนาไปอย่างก้าวกระโดด สามารถปรับตัว เรียนรู้ และประมวลผลได้ในระดับที่เทียบเท่าหรือบางครั้งเหนือกว่ามันสมองของมนุษย์เสียอีก AI สามารถเลียนแบบพฤติกรรมและรูปแบบความคิดของมนุษย์ได้อย่างง่ายดาย ผ่านอัลกอริทึม Machine Learning อย่างไรก็ตาม เมื่อ AI มี “พลังที่ยิ่งใหญ่ ก็ย่อมตามมาด้วยความรับผิดชอบอันใหญ่หลวง” และผลกระทบรุนแรงที่อาจเกิดขึ้นตามมา

การโจมตีทางไซเบอร์ด้วย AI หรือ AI Hacking เป็นภัยคุกคามรูปแบบใหม่ที่โลกไซเบอร์ต้องเผชิญ โดยอาศัยความสามารถของ AI ในการเรียนรู้และปรับตัว จึงถูกนำมาใช้ในการก่ออาชญากรรมไซเบอร์มากขึ้น รวมถึงสร้างภัยคุกคามใหม่ๆ ดังนั้นในบทความนี้ มาเรียนรู้เพิ่มเติมกันว่า AI ถูกนำมาใช้ในการก่ออาชญากรรมไซเบอร์อย่างไร ภัยคุกคามที่เกิดจาก AI และวิธีที่ AI ช่วยให้แฮกเกอร์สามารถโจมตีเครือข่ายหรือระบบต่างๆ นอกจากนี้ เรายังจะพูดถึงกลโกง (Scam) ที่นำ AI มาใช้ และวิธีการที่เราสามารถใช้ AI เพื่อป้องกันการโจมตีทางไซเบอร์

อันดับแรก เรามาทำความเข้าใจกันก่อนว่าทำไมการโจมตีทางไซเบอร์ด้วย AI ถึงได้รับความนิยมในวงกว้างมากขึ้น

การโจมตีทางไซเบอร์ด้วย AI ที่เพิ่มขึ้น

ในความจริง การแพร่ระบาดของการโจมตีทางไซเบอร์ด้วย AI ไม่ใช่เรื่องที่เหนือความคาดหมาย เพราะผู้เชี่ยวชาญด้านความปลอดภัยทางไซเบอร์หลายคน ได้คาดการณ์ถึงผลกระทบที่ร้ายแรงนี้มาตั้งแต่ต้น โดยการนำ AI มาใช้ในผลิตภัณฑ์กระแสหลักส่วนใหญ่ ทำให้กลายเป็นหนึ่งในเทคโนโลยีที่องค์กรต่างๆ ทั่วโลกต้องการใช้มากที่สุด ซึ่งมันยิ่งเป็นการกระตุ้นให้นักพัฒนา AI ผลิตโมเดลใหม่ๆ แต่ด้วยแรงกดดันจากผลประโยชน์เชิงพาณิชย์ ก็ยิ่งต้องเร่งผลิตโมเดล AI ใหม่ๆ ออกมา ส่งผลให้นักพัฒนามองข้ามความเสี่ยงด้านความปลอดภัยที่อาจเกิดขึ้น

รายงานล่าสุดจาก ศูนย์รักษาความปลอดภัยไซเบอร์แห่งชาติ (NCSC) ของสหราชอาณาจักร ได้ออกมาเตือนถึงภัยคุกคามจากการโจมตีด้วย AI อยู่เสมอ โดยระบุว่า “AI สามารถเพิ่มขีดความสามารถของแฮกเกอร์ในการโจมตีได้อย่างมาก และจะมีการเพิ่มจำนวนและความรุนแรงของการโจมตีทางไซเบอร์ในอีก 2 ปีข้างหน้า” (จากปี 2024) รายงานเดียวกันยังระบุว่า ยิ่งไปกว่านั้น AI ยังเปิดโอกาสให้กับอาชญากรไซเบอร์ที่ไม่มีทักษะในการดำเนินการการโจมตีทางไซเบอร์ หรือก็คือ AI กำลังทำให้การแฮกง่ายขึ้นและเข้าถึงได้ง่ายมากขึ้น ซึ่งส่งผลให้แฮกเกอร์จำนวนมากหันมาใช้เทคโนโลยี AI เพื่อช่วยหรือดำเนินการโจมตี

และจากบทสัมภาษณ์ของ Information Security Media Group ในงาน RSA Conference 2024 คุณ JC Raby กรรมการผู้จัดการและหัวหน้าด้านเทคโนโลยีเกิดใหม่ของ JP Morgan Investment Banking ได้เน้นย้ำว่า AI ถือเป็นชนวนเร่งภัยทางไซเบอร์ เนื่องจากคนร้ายสามารถใช้ AI เพื่อทำการโจมตีขนาดใหญ่ ผ่านช่องโหว่หลายๆ จุด ทั้งนี้ เมื่อ AI ได้กลายเป็นส่วนหนึ่งของการดำเนินธุรกิจและการทำงาน องค์กรจึงต้องตระหนักถึงวิธีที่ AI อาจถูกนำมาใช้ เพื่อป้องกันการโจมตีทางไซเบอร์และการขโมยข้อมูล (Data Loss Prevention)

AI ถูกนำมาใช้ในการโจมตีทางไซเบอร์อย่างไร?

หนึ่งในวิธีที่ AI ถูกนำมาใช้ในการโจมตีทางไซเบอร์ (Cyber Attacks) คือ ผ่านโมเดล Generative AI ซึ่งเป็นโมเดล AI ที่สามารถสร้างเนื้อหาใหม่ขึ้นมาเองด้วยตัวเองได้ ไม่ว่าจะเป็นตัวหนังสือ รูปภาพ วิดีโอ ฯลฯ ด้วยความสามารถดังกล่าว ประกอบกับความสามารถในการเรียนรู้จากข้อมูลที่ถูกป้อนลงไป ส่งผลให้ AI สร้างความขัดแย้งในหลายวงการ และกลายเป็นช่องโหว่ให้บริษัทจำนวนมากใช้ประโยชน์ในการสร้างเนื้อหาโดยไม่ต้องจ้างศิลปินหรือครีเอเตอร์

โดยโมเดล Large Language Models (LLMs) เช่น ChatGPT เป็นตัวอย่างของ Generative AI ที่ได้รับความนิยมมากที่สุดในปัจจุบัน ซึ่งสามารถสร้างเนื้อหาและตอบคำถามได้อย่างง่ายดาย แม้จะมีความไม่แม่นยำในหลายครั้ง บริษัทขนาดใหญ่อย่าง Google, Meta, Apple และอื่นๆ ต่างนำปัญญาประดิษฐ์รูปแบบนี้มาใช้ในผลิตภัณฑ์ของตนเช่นกัน แต่ในแง่ของการโจมตีทางไซเบอร์ อย่างน้อยที่สุดผู้ไม่ประสงค์ดีสามารถใช้ AI ในการสร้างอีเมลหรือเอกสารที่น่าเชื่อถือ เพื่อหลอกล่อคนให้ตกเป็นเหยื่อของการทำฟิชชิ่ง (Phishing) นอกจากนี้ Generative AI ยังสามารถนำมาใช้ในการสร้างมัลแวร์ที่สามารถปรับเปลี่ยนตัวเอง เพื่อเจาะระบบเครือข่าย หรือใช้ประโยชน์จากช่องโหว่ของไฟร์วอลล์ (Firewall) ได้

ยิ่งไปกว่านั้นแล้ว AI ยังสามารถสร้างวิดีโอ Deepfake ที่เป็นสื่อสังเคราะห์ ทั้งภาพนิ่ง เสียง หรือวิดีโอ ที่แทบแยกไม่ออกว่าเป็นคนจริงหรือไม่ AI จึงกลายเป็นเครื่องมือที่ถูกนำมาใช้เป็นอาวุธ เพื่อสร้างภัยคุกคามไซเบอร์ที่เรียนรู้ได้ด้วยตัวเอง ดูแล้วน่าเชื่อถือยิ่งขึ้น และแทบจะไม่เว้นช่องโหว่ให้ป้องกันตัวเลยก็ว่าได้

ในหัวข้อต่อไป เราจะเจาะลึกว่าการโจมตีทางไซเบอร์ด้วย AI คืออะไร และมีวิธีไหนบ้าง

การโจมตีทางไซเบอร์ด้วย AI คืออะไร?

การโจมตีทางไซเบอร์ด้วย AI หมายถึง การแฮก (Hack) ใดๆ ก็ตามที่นำกลไกของ AI มาใช้งาน โดยคุณสมบัติหนึ่งของ AI คือ อัลกอริธึม Machine Learning ที่สามารถเรียนรู้จากความผิดพลาดและแก้ไขตัวเองได้ ทำให้แฮกเกอร์สามารถใช้ AI มาวิเคราะห์ข้อมูลและเจาะระบบได้เร็วกว่ามาตรการรักษาความปลอดภัยทางไซเบอร์แบบดั้งเดิมจะป้องกันตัวเองได้ทัน สิ่งนี้จึงมอบความได้เปรียบทางกลยุทธ์แก่แฮกเกอร์ในการโจมตี

นอกจากนี้ AI ยังมีความสามารถในการเรียนรู้ข้อผิดพลาดและแก้ไขได้ทันที ช่วยให้สามารถหลีกเลี่ยงโปรโตคอลความปลอดภัยทางไซเบอร์ส่วนใหญ่ในปัจจุบันได้ง่ายขึ้น ยิ่งไปกว่านั้นการแฮกระบบด้วย AI ยังส่งผลให้กระบวนการล่าภัยคุกคามยากขึ้นมาก ด้วยความสามารถในการลบไฟล์บันทึก (Logs) ซึ่งปกติจะถูกใช้ในการติดตามร่องรอย หรือ “ลายนิ้วมือ” ของผู้ไม่ประสงค์ดี

ในหัวข้อต่อไป เราจะพูดถึงภัยคุกคามและกลโกง (Scam) ที่เกิดจาก AI ซึ่งพบเห็นได้บ่อยในปัจจุบัน

ภัยคุกคามและกลโกงที่เกิดจาก AI ในปัจจุบัน

ปัจจุบันแฮกเกอร์มีการเริ่มใช้ประโยชน์จาก AI ในรูปแบบที่สร้างสรรค์มากขึ้นอีก โดย Generative AI ถือเป็นหัวใจสำคัญของพัฒนาการเหล่านี้ แฮกเกอร์ใช้ Machine Learning ในการวางแผนการโจมตีแบบวิศวกรรมสังคม หรือ Social Engineering และการหลอกลวงแบบฟิชชิง (Phishing) ผ่านการสร้างอีเมล เอกสาร และเนื้อหาที่ดูสมจริง ซึ่งอาจมีมัลแวร์แฝงอยู่หรือมีเป้าหมายเพื่อขโมยข้อมูลส่วนตัวจากผู้ที่ไม่ทันระวังตัว

AI มักถูกใช้เพื่อสร้างอีเมล ปลั๊กอิน (plug-in) หรือข้อความปลอมขึ้นมา เพื่อหลอกลวงพนักงานในองค์กร หรือบุคคลทั่วไปที่ไม่ทันระวังตัวให้เปิดเผยข้อมูลลับ เช่น รหัสผ่าน หรือปล่อยมัลแวร์เข้าสู่ระบบเครือข่าย นอกจากนี้ AI ยังสามารถตรวจจับช่องโหว่ในระบบได้ภายในไม่กี่วินาที และทำการใช้ประโยชน์จากจุดอ่อนเหล่านั้น เช่น การเปรียบเทียบระหว่างเวอร์ชันซอฟต์แวร์ที่เผยแพร่แล้ว เพื่อดูว่ามีการแก้ไขอะไรบ้าง หรือการวิเคราะห์โค้ด open-source

รายงานจากคณะกรรมการพิเศษว่าด้วยผู้สูงอายุแห่งวุฒิสภาสหรัฐฯ ได้แจ้งเตือนว่า แชทบอท (Chatbot) สามารถจำลองการสนทนาเหมือนมนุษย์ และแฮกเกอร์อาจใช้สิ่งนี้เพื่อดึงข้อมูลส่วนตัว อีกทั้ง ผู้ไม่ประสงค์ดีอาจใช้ Deepfake หรือเทคนิคเลียนแบบเสียง (Voice Cloning) เพื่อปลอมตัวเป็นบุคคลที่ดูน่าเชื่อถือ เพื่อขอข้อมูลหรือรายละเอียดส่วนตัว หรือหลอกลวงให้คนมาลงทุน อย่างเช่น คริปโตและอื่นๆ ซึ่ง Patrick Hillmann อดีต CCO ของ Binance ได้ตกเป็นเหยื่อของนักต้มตุ๋นที่ใช้ Deepfake ในปี 2022 เมื่อพวกเขาใช้ปัญญาประดิษฐ์เพื่อเลียนแบบภาพลักษณ์ของเขา และพยายามที่จะหลอกลวงเหยื่อในอุตสาหกรรมคริปโต

จะเห็นได้ว่า ปัญญาประดิษฐ์ (AI) กำลังถูกนำมาใช้ในการโจมตีทางไซเบอร์มากขึ้นเรื่อยๆ เช่น การสร้าง Ransomware ที่ซับซ้อนและหลบหลีกการตรวจจับได้ยาก การโจมตีแบบ Phishing และการขโมยข้อมูลด้วยเทคนิคใหม่ๆ องค์กรจึงต้องให้ความสำคัญในการเสริมสร้างระบบป้องกันด้วยเทคโนโลยีที่ทันสมัย เช่น ไฟร์วอลล์รุ่นใหม่ (Next Generation Firewall) อย่าง Sangfor NGFW ติดตั้งระบบ EDR และ MDR เพื่อตรวจจับและตอบสนองต่อภัยคุกคามได้อย่างรวดเร็ว รวมถึงการใช้เทคโนโลยี Data Loss Prevention เพื่อป้องกันการสูญหายของข้อมูลสำคัญ

แม้ว่าโมเดล Language Learning Models ส่วนใหญ่จะสามารถระบุและป้องกันไม่ให้แพลตฟอร์มของตนถูกใช้ในการสร้างมัลแวร์ แต่แฮกเกอร์ก็สามารถหาวิธีหลอกลวงระบบได้ ซึ่งนำไปสู่การเกิดขึ้นของแพลตฟอร์มแฮกอย่าง HackedGPT และ WormGPT ที่ให้การช่วยเหลือผู้ไม่ประสงค์ดีในการสร้างมัลแวร์ โดยเครื่องมือเหล่านี้สามารถใช้สำหรับการแฮก การปลอมแปลงบัตรเครดิต การขโมยข้อมูลตัวตน การรั่วไหลของข้อมูล และอื่นๆ ดังนั้น สิ่งสำคัญที่องค์กรและผู้ใช้งานอินเทอร์เน็ตต้องคำนึงคือ ปัญญาประดิษฐ์ถูกใช้ในการหาเป้าหมาย เพื่อป้องกันตัวเองจากการถูกแฮก

แฮกเกอร์และสแกมเมอร์ ใช้ AI ในการเล็งหาเป้าหมายอย่างไร

AI สามารถนำมาใช้ในหลายวิธีเพื่อเพิ่มประสิทธิภาพและยกระดับการโจมตีทางไซเบอร์หรือการทำวิศวกรรมสังคม (Social Engineering) โดยรายงานปี 2020 จาก ศูนย์ Georgetown Center for Security and Emerging Technology ได้ศึกษาการใช้งาน ปัญญาประดิษฐ์ที่เป็นไปได้ในกิจกรรมต่างๆ และระบุความเสี่ยงที่คล้ายคลึงกัน โดยระบุว่าระบบอัตโนมัติ (Automation) เป็นปัจจัยสำคัญที่ทำให้แฮกเกอร์บางรายหันมาใช้ Machine Learning ในการโจมตีทางไซเบอร์ รายงานยังกล่าวไว้อีกว่า Machine Learning มีศักยภาพในการเพิ่มทั้งขนาดและอัตราความสำเร็จของการโจมตีแบบสเปียร์ฟิชชิ่ง (Spear Phishing) และวิศวกรรมสังคม

นั่นหมายความว่า ปัญญาประดิษฐ์มักถูกใช้ในการสร้างอีเมลปลอม ไฟล์แนบ และข้อความต่างๆ เพื่อล่อลวงพนักงานบริษัทที่ไม่รู้หรือไม่ทันระวังตัว หรือบุคคลทั่วไปให้เปิดเผยข้อมูลส่วนตัว หรือนำมัลแวร์เข้าสู่เครือข่ายโดยไม่รู้ตัว นอกจากนี้ ปัญญาประดิษฐ์ยังสามารถใช้ในการตรวจหาช่องโหว่ในระบบภายในไม่กี่วินาที ซึ่งสามารถทำได้โดยการเปรียบเทียบย้อนกลับระหว่างเวอร์ชันของซอฟต์แวร์ที่เผยแพร่เพื่อระบุส่วนที่ได้รับการแก้ไข หรือโดยการวิเคราะห์ Open-source Code ซึ่งความเร็วของ ปัญญาประดิษฐ์เป็นส่วนสำคัญในกระบวนการนี้

ต่อไปเรามาสำรวจภัยคุกคามจากปัญญาประดิษฐ์ที่เฉพาะเจาะจงมากขึ้น เพื่อดูให้รู้ว่าผู้ไม่ประสงค์ดีเล็งเป้าหมายอย่างไร

ภัยคุกคามจาก AI Hacking

ภัยคุกคามจากการแฮ็กด้วย AI มีหลากหลายรูปแบบ เมื่อเทคโนโลยีนี้ได้รับการพัฒนาอย่างต่อเนื่องเพื่อแก้ปัญหาที่ซับซ้อนมากขึ้น หรือแทรกซึมระบบรักษาความปลอดภัยที่ซับซ้อนมากขึ้น พูดได้ว่าจำนวนภัยคุกคามจากการแฮกด้วย AI จะเพิ่มขึ้นเรื่อยๆ ทั้งนี้ ในปัจจุบัน ภัยคุกคามทางไซเบอร์จาก AI นั้นมีหลากหลายรูปแบบ ดังนี้

1. การแฮกด้วย Deepfake

Deepfake ถูกสร้างขึ้นโดยใช้ Generative AI เพื่อเลียนแบบลักษณะของมนุษย์ โดยทั่วไป Deepfake ถูกใช้เพื่อการโปรโมท โดยใช้รูปลักษณ์ของคนดัง นักการเมือง หรือบุคคลที่มีอำนาจอื่นๆ ในการโปรโมทแบรนด์หรือโครงการ ซึ่ง Deepfake จะใช้ภาพวิดีโอ ภาพถ่าย และการบันทึกเสียงที่มีอยู่เพื่อสร้างคลิปวิดีโอและเสียงใหม่ๆ ด้วยปัญญาประดิษฐ์ โดยปัญญาประดิษฐ์ สามารถใช้การสลับใบหน้าและการปรับแต่งใบหน้าเพื่อเลียนแบบการเคลื่อนไหวของใบหน้าเหยื่อและสร้างวิดีโอที่ดูน่าเชื่อถือเพื่อหลอกลวงผู้คน

แม้ว่าอาจดูเหมือนเป็นการหลอกลวงง่ายๆ ที่จะใช้หลอกคุณปู่คุณย่าให้คิดว่า มีดาราคนหนึ่งต้องการให้พวกเขาช่วยซื้อ iPhone แต่ Deepfake สามารถส่งผลกระทบต่อทุกคน ซึ่งการโจมตีด้วย Deepfake สามารถชักจูงพนักงานให้เปิดเผยข้อมูลลับจากบุคคลที่ดูน่าเชื่อถือ วิดีโอเหล่านี้ยังสามารถใช้เผยแพร่การโฆษณาชวนเชื่อ และอาจมีผลกระทบอย่างมากโดยเฉพาะในช่วงที่เกิดความไม่สงบหรือความไม่แน่นอนทางการเมือง หรือแม้กระทั่งก่อให้เกิดความเสียหายต่อชื่อเสียง การบิดเบือนข้อมูล และความสูญเสียทางการเงิน โดย World Economic Forum รายงานว่า 66% ของผู้เชี่ยวชาญด้านความปลอดภัยทางไซเบอร์พบการโจมตีด้วย Deepfake ภายในองค์กรของตนในปี 2022 เพียงปีเดียว

2. การสร้างมัลแวร์ AI Hacking

แฮกเกอร์สามารถใช้ Generative AI ในการสร้างมัลแวร์แบบโพลีมอร์ฟิก (Polymorphic Malware) ที่สามารถปรับตัวและเปลี่ยนแปลงโค้ดต้นฉบับของตัวเอง เพื่อหลีกเลี่ยงการตรวจจับ และโปรโตคอลความปลอดภัยต่างๆ ซึ่งป้องกันได้ยาก หากยังใช้งานแอนตี้ไวรัสแบบดั้งเดิมที่ใช้การระบุตัวตนแบบ Signature-based นอกจากนี้ แม้ว่าการสร้างมัลแวร์ด้วย ปัญญาประดิษฐ์ จะพยายามถูกควบคุมโดยแพลตฟอร์มส่วนใหญ่ แต่ Forum ใน Dark Web หลายแห่งยังคงนำเสนอการสร้างมัลแวร์ด้วยปัญญาประดิษฐ์

3. การใช้ AI เพื่อทำ Social Engineering

วิศวกรรมสังคม (Social Engineering) เป็นการมุ่งเน้นการหลอกล่อให้ผู้คนเปิดเผยข้อมูลประจำตัว หรือเปิดลิงก์และไฟล์ที่น่าสงสัย เมื่อนำมาประกอบการ Generative AI แฮกเกอร์สามารถทำการสแกมด้วยวิศวกรรมสังคมแบบอัตโนมัติ และมีประสิทธิภาพเพื่อชักนำผู้คนและเข้าถึงข้อมูลส่วนตัว

4. การโจมตีแบบ Brute Force ด้วย AI

การโจมตีทางไซเบอร์แบบ Brute Force คือ การพยายามเดารหัสผ่านเพื่อเจาะระบบที่มีการรักษาความปลอดภัย และด้วยการใช้ AI การโจมตีดังกล่าวจะสามารถทำงานได้อัตโนมัติ และช่วยให้แฮกเกอร์สามารถวิเคราะห์พฤติกรรมของผู้ใช้เพื่อค้นหารหัสผ่านได้เร็วขึ้น

5. การโจมตีด้วย Phishing และ AI

ภัยคุกคามจากการแฮกด้วย AI ที่พบบ่อยอีกอย่างคือ ฟิชชิ่ง (Phishing) ที่เพิ่มขึ้น การโจมตีเหล่านี้อาศัยการหลอกลวงพนักงานหรือบุคคลให้เชื่อว่ามีการติดต่อมาจากแหล่งที่น่าเชื่อถือ โดย AI สามารถ Streamline การโจมตีได้ด้วยการสร้างอีเมลฟิชชิ่งแบบอัตโนมัติที่มีการปรับแต่งให้น่าเชื่อถือมากขึ้น

โดยตามการวิเคราะห์พบว่า ปัญญาประดิษฐ์สามารถสังเกตและสร้างรูปแบบการหลอกลวงด้วยฟิชชิ่ง โดย Harvard Business Review รายงานว่า 60% ของผู้เข้าร่วมตกเป็นเหยื่อของการทำฟิชชิ่งอัตโนมัติด้วย AI เมื่อเทียบกับการหลอกลวงด้วยฟิชชิ่งที่ไม่ใช้ปัญญาประดิษฐ์ นอกจากนี้ การทำฟิชชิ่งอัตโนมัติโดยใช้โมเดลภาษาขนาดใหญ่ (LLMs) ยังช่วยลดต้นทุนการโจมตีมากกว่า 95% ในขณะที่ได้อัตราความสำเร็จเท่ากันหรือมากกว่า ทำให้เป็นตัวเลือกที่น่าดึงดูดที่สุดสำหรับผู้ไม่ประสงค์ดีทั้งหลาย

6. การเจาะระบบ CAPTCHA ด้วย AI

CAPTCHA เป็นระบบที่ถูกใช้มานานเพื่อกำจัด Bot ในอินเทอร์เน็ตและตรวจสอบว่าผู้ใช้เป็นมนุษย์จริง อย่างไรก็ตาม ปัญญาประดิษฐ์ก็ได้พิสูจน์ว่าสามารถแก้แบบฟอร์ม CAPTCHA ได้ โดยการวิเคราะห์ภาพและเลือกตามรูปแบบพฤติกรรมมนุษย์ที่เรียนรู้มา

7. การลอกเลียนเสียงด้วย AI Hacking

คล้ายกับการทำ Deepfake ระบบ AI สามารถทำการลอกเลียนเสียงได้เช่นกัน โดย Voice Biometrics ถือเป็นมาตรการรักษาความปลอดภัยที่พบบ่อยสำหรับอุปกรณ์และระบบหลายประเภท ซึ่งปัญญาประดิษฐ์สามารถลอกเลียนแบบลายนิ้วมือเสียง (Audio Fingerprints) และเลียนแบบคลิปเสียงจากเสียงตัวอย่างได้ นั่นหมายความว่าระบบที่ป้องกันด้วยเสียงมีความเสี่ยง และผู้คนอาจถูกหลอกให้คิดว่าไฟล์เสียงนั้นเป็นของจริงทั้งที่ไม่ใช่ ซึ่งเอื้อต่อการแฮ็ก การบิดเบือนข้อมูล และการขโมยตัวตน

8. การดักข้อมูลผ่าน Keystroke ด้วย AI

อีกวิธีหนึ่งที่แฮกเกอร์สามารถใช้ AI ในการโจมตีทางไซเบอร์ คือ การดักข้อมูลผ่านการพิมพ์หรือ Keystroke โดย AI บางตัวสามารถบันทึกปุ่มต่างๆ ที่พิมพ์บนแป้นพิมพ์ เพื่อขโมยรหัสผ่านด้วยความแม่นยำถึง 95%

ภัยคุกคามทางไซเบอร์จาก AI มาในหลากหลายรูปแบบ เพื่อขโมยข้อมูลสำคัญ แม้ว่าวิธีการเหล่านี้อาจดูเหลือเชื่อ แต่ AI Hacking นั้นมีการพัฒนาอย่างต่อเนื่อง ต่อไป มาดูสถิติที่น่าตกใจกันต่อเกี่ยวกับการโจตีด้วย AI กันเลย

สถิติด้าน AI Hacking และ Cybersecurity

เมื่อพูดถึง AI ในแง่ของ Cybersecurity แน่นอนว่า บริษัทและนักพัฒนาต่างต้องปกป้องผลประโยชน์ของตนก่อนที่จะกำหนดมาตรการป้องกันที่มีประสิทธิภาพต่อ AI Hacking โดยองค์กรมีหน้าที่ในการให้ความรู้แก่ตนเองและพนักงานเกี่ยวกับความเสี่ยงของการโจมตีทางไซเบอร์ แม้ว่าการแฮกด้วย AI อาจตรวจจับและแก้ไขได้ยาก แต่ก็จำเป็นต้องทราบว่าการแฮกด้วย AI Hacking ได้เปลี่ยนแปลงภูมิทัศน์ด้าน Cybersecurity อย่างไร ถ้าอย่างนั้น มาดูสถิติบางส่วนเกี่ยวกับการโจมตีทางไซเบอร์ด้วย AI

- ตลาดทั่วโลกสำหรับผลิตภัณฑ์ความปลอดภัยทางไซเบอร์ที่ใช้ AI คาดว่าจะเติบโตถึง 133.8 พันล้านดอลลาร์ภายในปี 2030 เพิ่มขึ้นจาก 14.9 พันล้านดอลลาร์ในปี 2021 (CNBC)

- เนื้อหาออนไลน์มากถึง 90% อาจถูกสร้างขึ้นโดยการใช้ AI ภายในปี 2026 (WeForum)

- ธุรกิจที่ได้รับผลกระทบจากการหลอกลวงที่ขับเคลื่อนด้วย AI มักไม่เพียงสูญเสียผลประโยชน์ทางการเงินโดยตรง แต่ยังเผชิญกับการสูญเสียความเชื่อมั่นของลูกค้า และผลกระทบทางกฎหมายที่อาจเกิดขึ้น (รายงานภัยคุกคาม Sophos 2024)

- การใช้ AI ในสหราชอาณาจักรจะทำให้การโจมตีทางไซเบอร์มีผลกระทบมากขึ้น เนื่องจากผู้ไม่ประสงค์ดีจะสามารถวิเคราะห์ข้อมูลที่ถูกขโมยได้เร็วและมีประสิทธิภาพมากขึ้น และใช้ข้อมูลนั้นในการฝึกโมเดล AI ต่อไป

- 75% ของผู้เชี่ยวชาญด้านความปลอดภัยพบว่า การโจมตีเพิ่มขึ้นในช่วง 12 เดือนที่ผ่านมา โดย 85% ระบุว่าการเพิ่มขึ้นนี้เป็นผลมาจากผู้ไม่ประสงค์ดีที่ใช้ Generative AI (SecurityMagazine)

- ประมาณ 48% ของผู้ตัดสินใจด้านไอทีไม่มั่นใจว่าพวกเขามีเทคโนโลยีที่พร้อมป้องกัน Cyber Attacks ด้วย AI (Forbes)

- มีเพียง 52% ของผู้ตัดสินใจด้านไอทีที่แสดงความมั่นใจในความสามารถของตนในการตรวจจับวิดีโอ Deepfake ของ CEO ของพวกเขา (Forbes)

- AI ลดความท้าทายสำหรับอาชญากรไซเบอร์มือใหม่ แฮกเกอร์รับจ้าง และกลุ่ม Hacktivists ในการเข้าถึงและรวบรวมข้อมูลที่มีประสิทธิภาพ การเข้าถึงที่ง่ายขึ้นนี้จะส่งผลต่อภัยคุกคามจากแรนซัมแวร์ทั่วโลกในช่วงสองปีข้างหน้า (NCSC)

- ในปี 2025 เป็นต้นไป การทำให้ความสามารถที่ขับเคลื่อนด้วย AI กลายเป็นสินค้าในตลาดอาชญากรรมและการค้าจะทำให้ความสามารถที่พัฒนาขึ้นพร้อมใช้งานสำหรับอาชญากรรมทางไซเบอร์และตัวแทนของรัฐอย่างแน่นอน (NCSC)

รายงานจากศูนย์ความปลอดภัยทางไซเบอร์แห่งชาติของสหราชอาณาจักร (NCSC) ระบุว่า ปัญญาประดิษฐ์จะเพิ่มปริมาณและยกระดับผลกระทบของการโจมตีทางไซเบอร์ในช่วงสองปีข้างหน้าอย่างแน่นอน อย่างไรก็ตาม ผลกระทบของภัยคุกคามทางไซเบอร์ต่อแต่ละบุคคลและองค์กรอาจไม่เท่ากัน

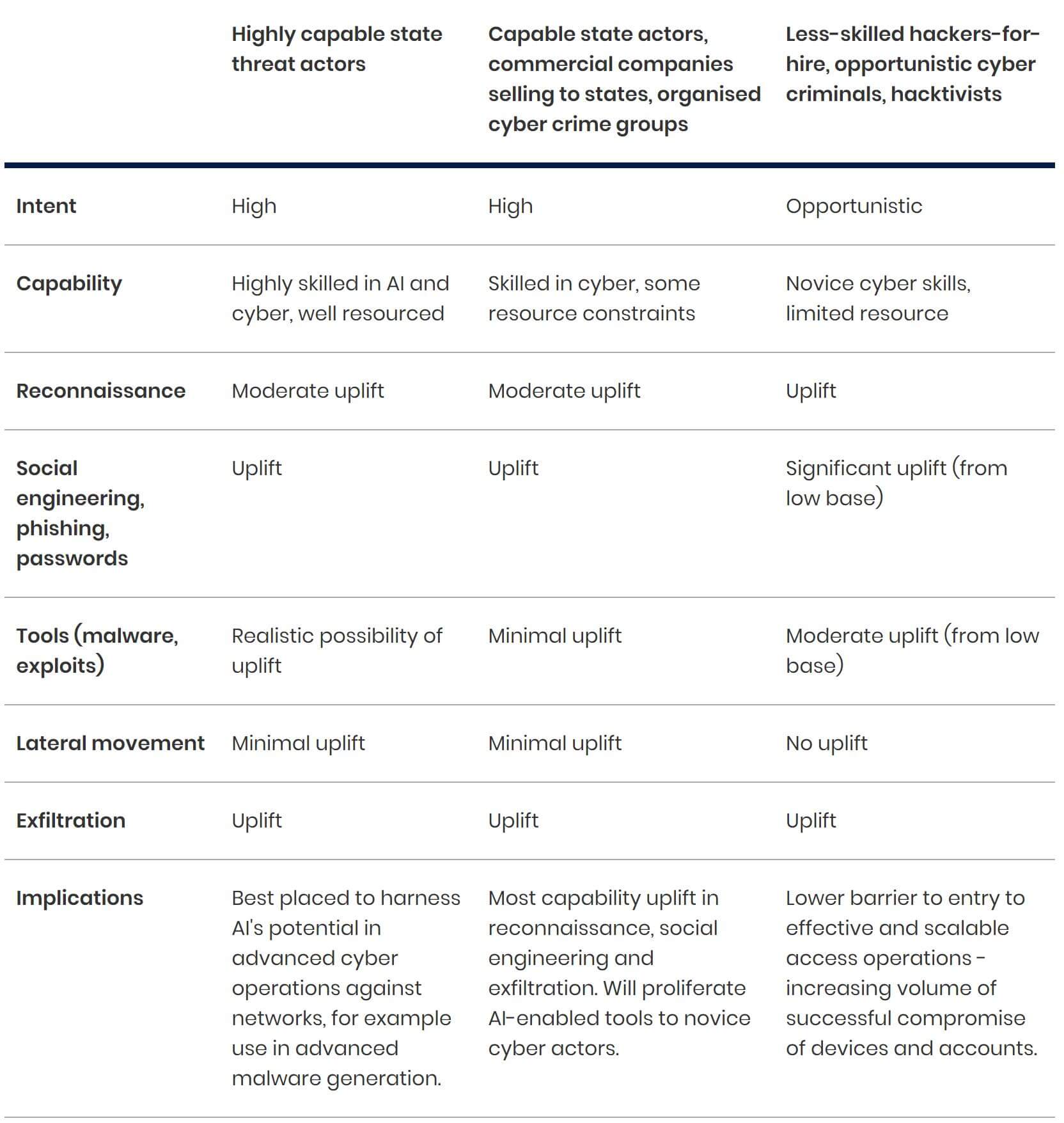

ตารางที่ 1: ระดับการยกระดับความสามารถที่เกิดจาก AI ในช่วง 2 ปีข้างหน้า

(อ้างอิง NCSC)

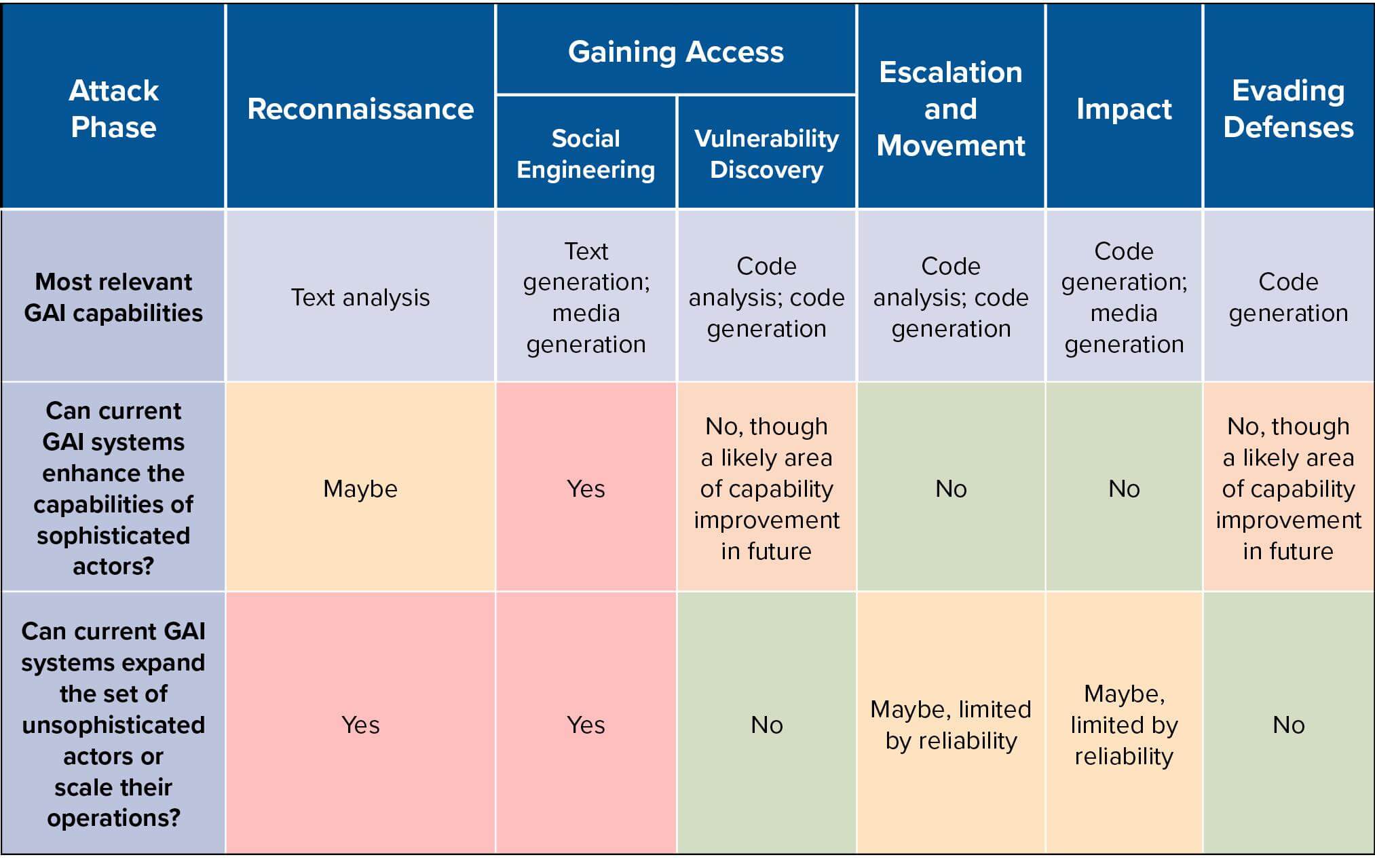

รายงานอีกฉบับโดย Maia Hamin และ Stewart Scott ได้จับคู่ความสามารถที่มีอยู่ของ Generative AI กับขั้นตอนต่างๆ ในวงจรของการโจมตีทางไซเบอร์ โดยสิ่งนี้ช่วยในการวิเคราะห์ว่าระบบเหล่านี้อาจเปลี่ยนแปลงภูมิทัศน์การโจมตีทางไซเบอร์หรือไม่และอย่างไร

ตารางที่ 2: ภาพรวมความสามารถที่เกี่ยวข้องของ Generative AI (GAI) และระดับการเพิ่มขีดความสามารถในแต่ละขั้นตอนของวงจรการโจมตีทางไซเบอร์ อ้างอิงจากรายงาน Hacking with AI Report

แม้ว่าจะยังไม่มีหลักฐานว่าระบบโมเดลภาษาขนาดใหญ่ (LLM) สามารถดำเนินการหลายขั้นตอนของการโจมตีทางไซเบอร์ทั้งหมดได้โดยไม่ต้องอาศัยการควบคุมจากมนุษย์ แต่มีหลายปัจจัยที่ต้องให้ความสนใจอย่างต่อเนื่อง อย่างการพิจารณาวิธีที่กระบวนการเรียนรู้แบบไม่มีผู้สอน (Unsupervised Learning) ที่สร้างความสามารถที่เกินความคาดหมาย รวมถึงการเพิ่มความสนใจและพลังงานในการพัฒนาระบบอัตโนมัติ เพื่อรับมือกับความท้าทายเหล่านี้ โดยรายงานได้สรุปด้วยข้อเสนอแนะเชิงนโยบายสำหรับระบบ AI ดังนี้

- พัฒนามาตรฐานการทดสอบสำหรับโมเดลชั้นนำที่ประเมินความเสี่ยงทางไซเบอร์ในขั้นตอน ผู้กระทำ และระดับความเป็นอัตโนมัติต่างๆ โดยให้ความสำคัญกับความโปร่งใสและการมีส่วนร่วม

- ประเมินและจัดการความเสี่ยงทางไซเบอร์ที่เกิดจากระบบ Generative AI ในขณะที่ปกป้องความเท่าเทียมในการพัฒนาโมเดลแบบเปิด

- ระดมทรัพยากรเพื่อเร่งงานด้านเทคนิคและการกำหนดมาตรฐานสำหรับการติดฉลากเนื้อหา AI โดยเน้นที่ศักยภาพในการนำไปปฏิบัติจริง

- ลงทุนในโครงสร้างนโยบายและมาตรการทางเทคนิค เพื่อจัดการความเสี่ยงที่อาจเกิดขึ้นจากตัวแทนอัตโนมัติที่ใช้ AI (AI-based Autonomous Agent)

การจำกัดการใช้ ปัญญาประดิษฐ์ ในทางที่ผิดเป็นปัญหาความปลอดภัยทางไซเบอร์ที่ใหญ่มากและต้องได้รับการปฏิบัติในฐานะที่เป็นเช่นนั้น คำสั่งเกี่ยวกับ AI ล่าสุดจาก Biden Administration ชี้นำรัฐบาลไปในทิศทางที่ถูกต้อง โดยกำหนดให้นักพัฒนาและผู้ให้บริการ Infrastructure-as-a-Service (IaaS) ต้องรายงานต่อรัฐบาลกลางเกี่ยวกับการฝึก “Dual-use Foundation Models” ซึ่งถูกกำหนดในแง่ของศักยภาพที่อาจก่อให้เกิดภัยคุกคามร้ายแรงต่อความมั่นคงของชาติ เช่น การเปิดใช้งานการปฏิบัติการทางไซเบอร์แบบอัตโนมัติเชิงรุก

ดั่งสำนวนที่ว่า “หนามยอกเอาหนามบ่ง” การต่อกร AI Hacking ที่มีประสิทธิภาพ คือ การนำโซลูชันความปลอดภัยทางไซเบอร์ที่ขับเคลื่อนด้วย AI มาใช้งานในการคาดการณ์ ตรวจจับ และกำจัดภัยคุกคามทางไซเบอร์แบบเรียลไทม์ด้วยค่าใช้จ่ายที่ลดลงและความแม่นยำสูง อีกทั้งด้วยความสามารถในด้าน Automation คล้ายกัน ทำให้สามารถนำมาใช้วิเคราะห์ชุดข้อมูลขนาดใหญ่เพื่อหาความผิดปกติได้

Sangfor ใช้ AI ในแพลตฟอร์ม Cybersecurity หลายแพลตฟอร์มเพื่อปรับปรุงการประมวลผล ทำงานอัตโนมัติ และให้บริการโซลูชันการทดสอบและตรวจสอบที่มีประสิทธิภาพมากขึ้น โดย Sangfor Cyber Command ใช้อัลกอริธึม AI ที่ได้รับการปรับปรุงเพื่อตรวจสอบมัลแวร์ เหตุการณ์ด้านความปลอดภัยที่ตกค้าง และความเสี่ยงที่อาจเกิดขึ้นในอนาคตในเครือข่าย นอกจากนี้ยังจับคู่กับเทคโนโลยี Threat Intelligence ขั้นสูงเพื่อแจ้งให้คุณทราบถึงช่องโหว่ที่ตรวจพบ

นอกจากนี้ เทคโนโลยี Endpoint Secure หรือ EDR, MDR รวมถึง Sangfor NGFW ที่ใช้ AI Detection Engine และให้การป้องกันแบบบูรณาการจากมัลแวร์และการโจมตีแบบต่อเนื่อง (Advanced Persistent Thret: APT) ทั่วทั้งเครือข่ายขององค์กร หากนำมาใช้อย่างถูกต้อง AI สามารถเป็นเครื่องมือความปลอดภัยทางไซเบอร์เชิงกลยุทธ์ และจะปกป้ององค์กรของคุณได้ดีที่สุดในยุคที่ AI Hacking กำลังเพิ่มขึ้น

แม้จะมีการโจมตีทางไซเบอร์ด้วย AI ที่หลากหลาย แต่สิ่งสำคัญคือต้องลงทุนในเทคโนโลยีที่สามารถมีประสิทธิภาพจริงๆ ในสภาพแวดล้อมดิจิทัลที่กำลังพัฒนา ปกป้องอนาคตของคุณและติดต่อ Sangfor Technologies วันนี้เพื่อดูว่าเราสามารถใช้ AI เพื่อปกป้องคุณได้อย่างไร

คำถามที่พบบ่อย

1. AI ในอาชญากรรมไซเบอร์คืออะไร?

ปัญญาประดิษฐ์ (Artificial Intelligence: AI) ในอาชญากรรมไซเบอร์เป็นเครื่องมือที่สามารถใช้ในการคาดการณ์รูปแบบ วิเคราะห์ข้อมูล และทำงานอัตโนมัติภายในการโจมตีทางไซเบอร์ หรือสามารถใช้เพื่อยกระดับแพลตฟอร์มความปลอดภัยทางไซเบอร์

2. AI Attacks คืออะไร?

การโจมตีด้วยปัญญาประดิษฐ์ หรือ AI Attack คือ การโจมตีทางไซเบอร์ที่ใช้ ปัญญาประดิษฐ์ เป็นเครื่องมือหลัก

3. แฮกเกอร์ใช้ AI อย่างไร?

แฮกเกอร์สามารถใช้ ปัญญาประดิษฐ์ เพื่อ

- สร้างมัลแวร์ (Malware)

- สร้างวิดีโอดีพเฟค (Deepfake)

- สร้างอีเมลฟิชชิ่ง (Phishing) และสแกมต่างๆ

- ดำเนินการโจมตีด้วยวิศวกรรมสังคม (Social Engineering)

- เลียนแบบเสียง (Clone voices)

- เจาะระบบ CAPTCHA

- ดักข้อมูลจากการพิมพ์ (Keystrokes)

- ใช้ในการโจมตีแบบ Brute Force

4. แฮกเกอร์และสแกมเมอร์ใช้ AI อย่างไร?

แฮกเกอร์ส่วนใหญ่จะใช้เครื่องมือ AI ในการวิเคราะห์ข้อมูลจำนวนมากเพื่อค้นหาข้อมูลส่วนตัว และพวกเขายังสามารถใช้เพื่อสร้างมัลแวร์ การฟิชชิ่ง (Phishing) และเนื้อหา Deepfake หรือเพื่อทำให้การแฮกเป็นไปโดยอัตโนมัติ